100日間を振り返って

前回のブログで本気出す,と言いつつ何の音沙汰もなかったが,どうだったかというと,,,

続いてませんでしたorz

本を買って読み始めて読み終わらずに満足することってアルヨネ〜

反省...

というわけで改めて勉強を復活しようと思う.

ただ続けても前回と同じく挫折するので,目標を決めて続けていこうと思う.

目標1:1〜2日に1度はブログ更新

目標2:決めた本を最後までやりきる

(1冊/月でやりたいが,厳しそうなので始めは1冊/2ヶ月を目標に)

1冊目はこの本.

300ページなので1日10ページ.(そう考えるとイケそう)

※今更だけどML,Python初心者には丁度いいハズ

今日の学習内容

とりあえず2章に入ったので,今日やったことのおさらい.

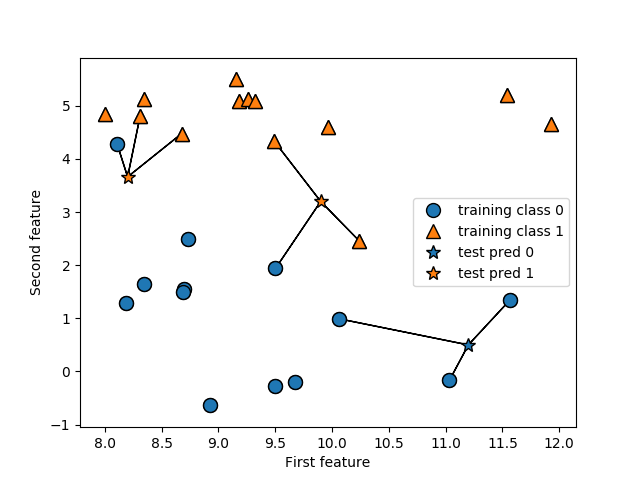

k-最近傍法(k-NN)

テストデータの最も近い点のクラスに分類.最も近い複数の値の多数決でクラスを分類することもある.

import mglearn import matplotlib.pyplot as plt X, y = mglearn.datasets.make_forge() # データセットをプロット mglearn.discrete_scatter(X[:, 0], X[:, 1], y) # 判例 plt.legend(["Class 0", "Class 1"], loc=4) plt.xlabel("First feature") plt.ylabel("Second feature") print("X.shape: {}".format(X.shape)) mglearn.plots.plot_knn_classification(n_neighbors=3) plt.plot() plt.savefig("image.png")

こう書くだけで,データセットの3近傍法が使える. 図はこんな感じで表示される.

今日はこんなところで.

では!